Le HDR est l'une des technologies les plus discutées sur le Web ces dernières années. Qu'il s'agisse de téléviseurs et de films, ou d'écrans d'ordinateur et de jeux, le HDR prend pied sur bon nombre de nos appareils. Vous voulez savoir ce qu'est le HDR ? Connaissez-vous les différents types, normes et certifications HDR ? Si vous voulez comprendre pourquoi certains écrans sont meilleurs que d'autres en matière de HDR, et voir à quoi correspondent des termes tels que HDR10, HDR10+, Dolby Vision, DisplayHDR 400 ou DisplayHDR 1000, lisez cet article :

Contenu

- Qu'est-ce que le HDR ?

- Quels sont les différents formats HDR : HDR 10, HDR+, Dolby Vision et HLG ?

- Qu'est-ce que DisplayHDR ?

- Comment activer le HDR sur mon PC Windows 10 ?

- Y a-t-il autre chose que vous aimeriez savoir sur le HDR ?

Qu'est-ce que le HDR ?

HDR est un acronyme pour High Dynamic Range, et c'est une technologie conçue pour que les images ressemblent le plus possible au monde réel. HDR est un terme que vous pouvez entendre en photographie, ainsi que dans tout ce qui concerne les écrans.

Afin de rendre les images aussi authentiques que possible, les appareils avec HDR utilisent des gammes de couleurs plus larges, des zones lumineuses plus lumineuses et des noirs plus foncés pour les nuances. Tous ces éléments, associés à des rapports de contraste beaucoup plus équilibrés, rendent les images plus réalistes et précises, plus proches de ce que l'œil humain verrait dans le monde réel.

Un écran d'ordinateur avec HDR

Lorsqu'il s'agit d'images numériques affichées sur un moniteur, un téléviseur ou tout autre appareil similaire, le HDR est particulièrement visible dans les images ou les vidéos qui présentent des combinaisons complexes de couleurs et des zones claires et sombres. De tels exemples peuvent être des couchers de soleil et des levers de soleil, un ciel lumineux, des paysages enneigés, etc.

Quels sont les différents formats HDR : HDR 10, HDR+, Dolby Vision et HLG ?

En termes d'écrans, il existe trois grands formats HDR, ou profils si vous préférez : HDR 10 , HDR+ et Dolby Vision . Tous ces profils multimédias s'appliquent à la fois à la manière dont le contenu vidéo est enregistré ou rendu, et à la manière dont ce contenu est affiché par les appareils dotés d'écrans HDR. Bien qu'ils visent tous la même chose - afficher des images plus réalistes - ils ont des exigences, des spécifications et des propriétés différentes.

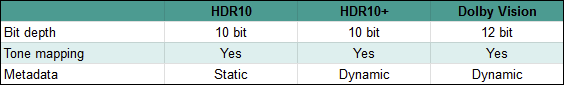

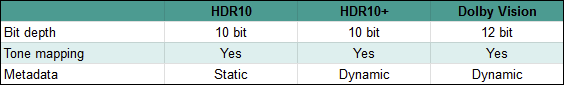

Les critères essentiels qui définissent les différents profils HDR sont liés à la qualité d'image. Voir le tableau ci-dessous pour une comparaison :

Comparaison entre HDR10, HDR10+ et Dolby Vision

Passons en revue ces critères un par un :

Peu profond. Habituellement, les moniteurs, les écrans d'ordinateurs portables, les téléviseurs et la plupart des autres écrans, y compris ceux des smartphones, utilisent des couleurs 8 bits . Cela leur permet d'afficher 16,7 millions de couleurs. Les écrans HDR ont une profondeur de 10 ou 12 bits, ce qui leur permet d'afficher respectivement 1,07 milliard de couleurs, soit 68,7 milliards de couleurs. HDR 10 et HDR10+ ont des couleurs 10 bits, tandis que Dolby Vision prend en charge une profondeur de 12 bits. Tous sont des nombres impressionnants et énormes. Cependant, vous devez savoir que, du moins pour le moment, il n'y a que des écrans 10 bits sur le marché (HDR et HDR+), donc même si Dolby Vision semble fantastique, vous ne pouvez en profiter sur aucun écran grand public. pour l'instant.

Luminosité maximale. Cela fait référence à la quantité minimale de luminance maximale pouvant être atteinte par un écran avec HDR. Pour que les écrans puissent afficher des images HDR, ils ont besoin de niveaux de luminosité plus élevés que les écrans SDR (Standard Dynamic Range) ordinaires. La luminosité maximale est mesurée en cd/m² et doit généralement être égale à au moins 400 cd/m². Lisez la section suivante de ce didacticiel pour voir les différentes normes HDR basées sur la luminosité maximale.

Luminosité noire maximale. Comme vous le savez, les écrans HDR ont pour objectif d'afficher des images les plus proches possible de la réalité. Pour ce faire, outre une luminance de crête élevée pour les zones d'image lumineuses, ils doivent également être capables d'afficher des zones sombres en utilisant des noirs très foncés. C'est là que la luminance maximale du niveau de noir entre en jeu. Les valeurs typiques pour cet attribut sont inférieures à 0,4 cd/m², mais il n'y a aucune exigence en ce qui concerne les protocoles HDR. Cependant, les normes VESA DisplayHDR ont des valeurs spécifiques pour la luminance maximale du niveau de noir, comme vous pouvez le voir dans la section suivante de cet article. Tout écran capable d'afficher des noirs à une luminosité inférieure à 0,0005 cd/m² est considéré comme du vrai noir .

Un téléviseur compatible HDR

Cartographie des tons.Le contenu créé avec HDR, comme les films ou les jeux, peut avoir des valeurs de luminosité beaucoup plus élevées que ce qu'un écran HDR peut réellement afficher. Par exemple, certaines séquences d'un film peuvent avoir des niveaux de luminosité supérieurs à 1000 cd/m², mais l'écran HDR sur lequel vous le regardez a une luminosité maximale de 400 cd/m². Que se passe-t-il alors ? Vous pourriez être tenté de penser que toutes les parties de l'image qui sont plus lumineuses que 400 cd/m² sont perdues. Ils ne le sont pas, du moins pas entièrement. Ce que font les écrans HDR, c'est ce qu'on appelle la cartographie des tons, qui utilise essentiellement des algorithmes pour réduire la luminosité des images filmées, afin qu'elle ne dépasse pas leur luminosité maximale. Bien sûr, certaines informations sont perdues de cette façon, et le contraste peut en fait sembler pire que sur un écran SDR (Standard Dynamic Range). Cependant, les images ont toujours plus de détails que sur les écrans SDR.

Métadonnées.Pour qu'un écran HDR puisse afficher du contenu HDR, qu'il s'agisse d'un film ou d'un jeu, ce contenu doit être créé avec HDR. Vous ne pouvez pas simplement filmer un film en SDR (Standard Dynamic Range) et vous attendre à ce qu'il soit affiché en HDR sur un téléviseur, par exemple. Le contenu créé avec HDR stocke des informations appelées métadonnées sur la façon dont il doit être affiché. Ces informations sont ensuite utilisées par les appareils sur lesquels vous lisez le contenu pour décoder correctement le contenu et utiliser juste la bonne quantité de luminosité, par exemple. Le problème est que tous les formats HDR n'utilisent pas le même type de métadonnées. HDR10 utilise des métadonnées statiques, ce qui signifie que les paramètres appliqués à l'affichage du contenu sont les mêmes du début à la fin. HDR10+ et Dolby Vision, quant à eux, utilisent des métadonnées dynamiques, ce qui signifie que les images affichées peuvent être ajustées à la volée. En d'autres termes, le contenu HDR peut utiliser différentes plages de luminosité sur différentes scènes, voire pour chaque image d'une vidéo.

Vous avez peut-être remarqué que nous n'avons encore rien mentionné à propos de HLG . HLG vient de Hybrid Log Gamma et représente une norme HDR qui permet aux distributeurs de contenu, tels que les sociétés de télévision, de diffuser du contenu télévisé à la fois SDR (Standard Dynamic Range) et HDR (High Dynamic Range) en utilisant un seul flux. Lorsque ce flux atteint votre téléviseur, le contenu est affiché soit en SDR, soit en HDR, selon ce dont votre téléviseur est capable.

Qu'est-ce que DisplayHDR ?

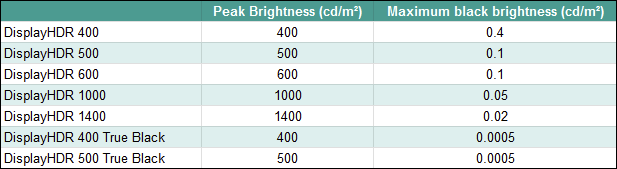

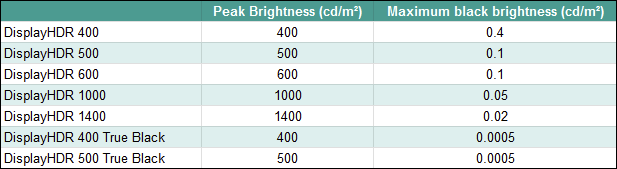

De plus, pour compliquer un peu les choses, outre les formats HDR, il existe également la spécification de performances HDR appelée DisplayHDR . Les appareils qui portent la certification DisplayHDR répondent à une série de normes qui garantissent qu'ils peuvent afficher des images avec HDR avec une certaine qualité. Si vous avez cherché sur Internet ou dans des magasins électroniques un nouveau téléviseur ou un moniteur à acheter, vous êtes peut-être tombé sur les termes DisplayHDR 400, DisplayHDR 600 ou Display HDR 1000, ou d'autres du même genre. Que signifient-ils?

Logo DisplayHDR certifié VESA

VESA (Video Electronics Standards Association), qui est une association internationale de plus de 200 entreprises du monde entier, crée et maintient des normes techniques pour tous les types d'écrans vidéo, y compris les téléviseurs et les écrans d'ordinateur. L'un des domaines dans lesquels ils ont établi de telles normes est le HDR. Leurs normes pour les écrans HDR sont appelées DisplayHDR et s'appliquent toutes aux écrans prenant en charge au moins HDR10. Pour être certifié DisplayHDR, un téléviseur, un moniteur et tout autre appareil doté d'un écran HDR doivent répondre aux normes de luminosité suivantes, entre autres spécifications plus techniques :

Exigences de luminosité pour les certifications VESA DisplayHDR

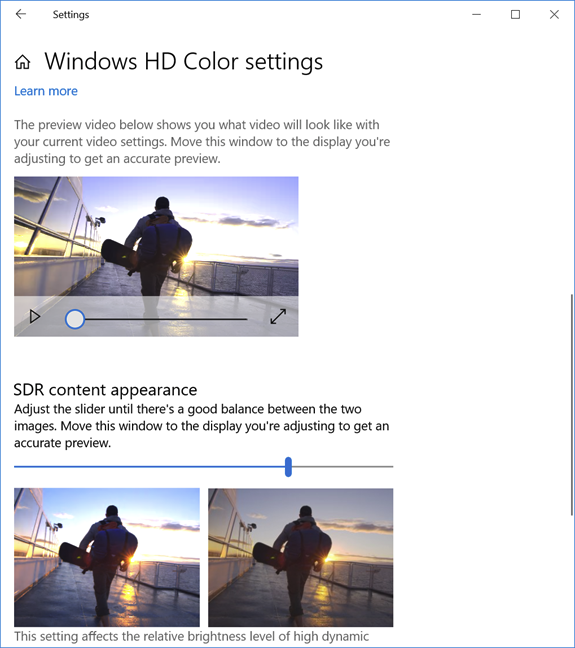

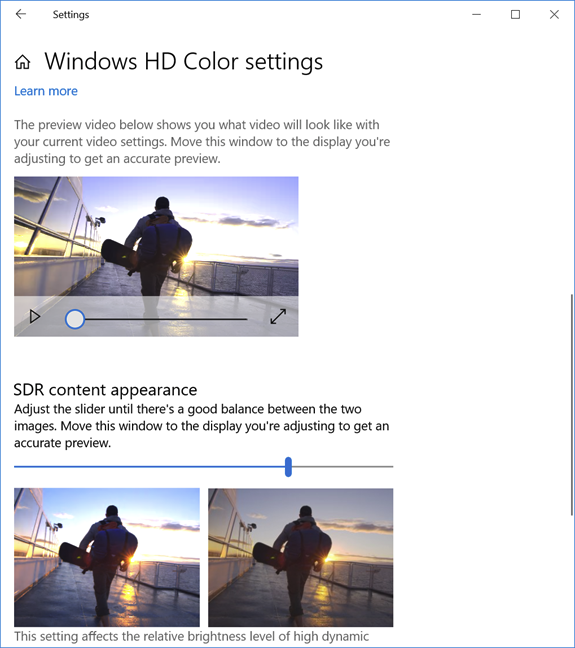

Comment activer le HDR sur mon PC Windows 10 ?

Pour terminer sur le HDR, nous aimerions vous parler un peu du HDR et de Windows 10 . Si vous utilisez un ordinateur ou un appareil Windows 10, un fait intéressant est que ce système d'exploitation ne prend en charge que HDR10 .

HDR dans Windows 10

De plus, vous pouvez profiter du contenu HDR dans les jeux ou les films sur votre PC uniquement si vous utilisez une carte graphique Nvidia GTX 900, GTX 10, GTX 16 ou RTX 20. Si vous êtes un utilisateur AMD, vous devez disposer d'une carte graphique AMD Radeon R9 série 38 ou 39 ou d'une Radeon RX 460 et supérieure. Si votre PC répond à ces critères et que vous avez également un moniteur HDR, vous voudrez peut-être apprendre à activer le HDR dessus : Comment activer le HDR sur mon ordinateur Windows 10 ?

Y a-t-il autre chose que vous aimeriez savoir sur le HDR ?

Nous espérons que nous avons réussi à faire la lumière sur ce qu'est le HDR et pourquoi vous le voudriez sur vos écrans. Avez-vous l'intention d'acheter un moniteur ou un téléviseur prenant en charge le HDR ? En avez-vous déjà un ou plusieurs ? Partagez vos opinions et questions, si vous en avez, dans la section des commentaires ci-dessous, et nous ferons de notre mieux pour vous aider.