Nvidia vient d'annoncer la sortie d'un modèle de langage étendu (LLM) open source qui devrait être aussi performant que les principaux modèles propriétaires d'OpenAI, Anthropic, Meta et Google.

Ce nouveau modèle s'appelle NVLM-D-72B avec 72 milliards de paramètres et fait partie de la grande famille de modèles de langage NVLM 1.0 récemment publiée par Nvidia. NVLM 1.0 est essentiellement une famille de grands modèles de langage multimodaux limites qui atteignent des résultats de pointe sur les tâches de langage visuel, en concurrence avec les principaux modèles propriétaires (par exemple, GPT-4o) ainsi qu'avec les modèles en accès libre.

Cette nouvelle famille de grands modèles de langage aurait des « capacités multimodales de niveau industriel », avec des performances supérieures sur une variété de tâches visuelles et linguistiques, en plus d'améliorer considérablement le retour d'information basé sur du texte. « Pour y parvenir, nous créons et intégrons un ensemble de données textuelles de haute qualité dans le processus de formation multimodale, ainsi qu'une grande quantité de données mathématiques et de raisonnement multimodales, ce qui permet d'améliorer les capacités mathématiques et de codage sur plusieurs modalités », ont expliqué les chercheurs de Nvidia dans un communiqué.

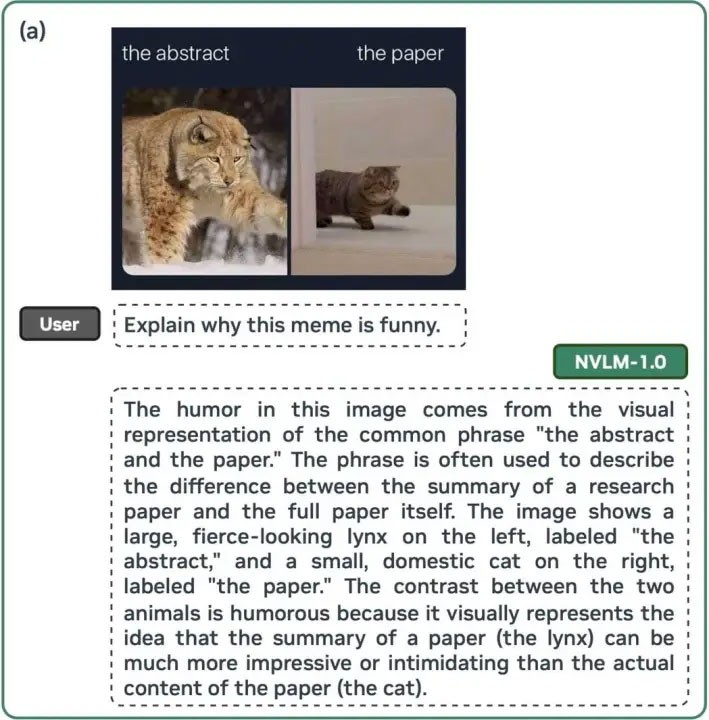

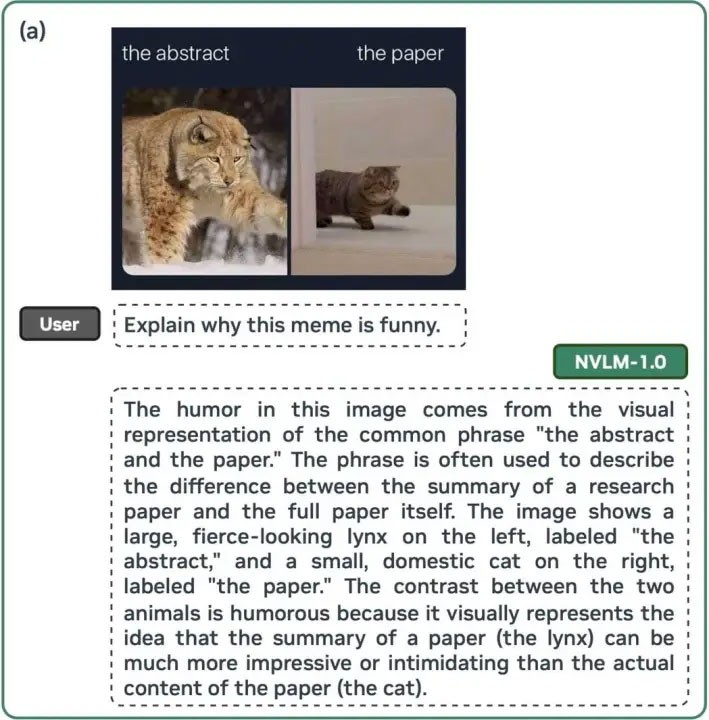

Le résultat est un LLM haute performance capable d’effectuer des tâches aussi simples qu’expliquer pourquoi un mème est drôle, jusqu’à des équations mathématiques complexes, étape par étape. Nvidia a également réussi à augmenter la précision du modèle en mode texte uniquement de 4,3 points en moyenne au-dessus des références de l'industrie, grâce à son style de formation multimodal.

Nvidia semble vouloir sérieusement s'assurer que ce modèle répond à la dernière définition de « open source » de l'Open Source Initiative, non seulement en rendant publics les poids d'entraînement pour examen par la communauté, mais également en promettant de publier le code source du modèle dans un avenir proche. Il s’agit d’un changement significatif par rapport à l’approche de concurrents comme OpenAI et Google, qui ont été très discrets sur la confidentialité des détails concernant les pondérations et le code source de leurs modèles LLM. Ce faisant, Nvidia a positionné NVLM non pas nécessairement comme un concurrent direct de ChatGPT-4o et Gemini 1.5 Pro, mais plutôt comme une plate-forme permettant aux développeurs tiers de créer leurs propres chatbots et applications d'IA.